BearManBull Escreveu:Também entendo que a cada iteração (epoch)

Nota importante: uma iteração não é uma epoch. Uma iteração é apenas um ciclo em que são fornecidos alguns dados à rede (tipicamente, uma batch ou mini-batch de dados). Uma epoch é repetir tantas iterações quantas as necessárias para percorrer todo o dataset (e tipicamente, no fim da epoch, as batches são reordenadas ou recriadas para que a rede não volte a ver o dataset todo exactamente da mesma forma que na epoch anterior).

BearManBull Escreveu:os neurônios se reorganizam na rede de forma a que normalmente se aumenta a probabilidade de dispararem um resultado que nos interessa.

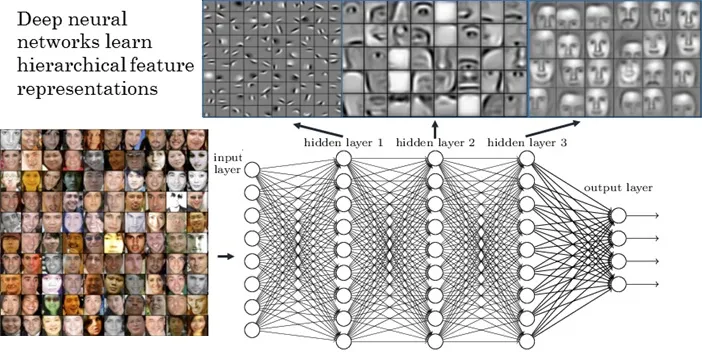

Bom, os neuronios não se reorganizam, mais precisamente o que se são recalculados são os pesos associados às ligações entre neuronios.

BearManBull Escreveu:Deixa-me ver se me explico. Normalmente teríamos uma varias imagens de números de 1 a 9. Este é o dataset e para treinar dizemos este desenho corresponde a 1, (...)

Sim, se for supervisionado. Em treino não supervisionado não é dado groundtruth à rede.

BearManBull Escreveu: (...) podendo depois passar várias imagens com caligrafias de várias pessoas para existir maior variedade. Isto constitui o treino. Ou seja no modelo clássico o treino é uma associação entre imagens e os valores contidos nessas imagens.

Exacto, a ideia geral é essa, neste caso estás a descrever uma rede a ser treinada para uma tarefa de classificação (mas há outras variantes).

BearManBull Escreveu:Quando a rede está pronta e em modo inference passamos a alimentar a rede com uma imagem (vista previamente ou não) e solicitamos à rede qual é o numero que está na imagem.

É isso.

BearManBull Escreveu:Ora agora temos um sistema diferente, temos redes alimentadas com dados de internet. No treino não existe uma tabela entre o que é esperado para um dado input.

Bom, o que estas redes estão treinadas é para remapear de uma pergunta (input) para uma resposta (output) utilizando linguagem natural. Estão treinadas para gerar uma conversa plausível. Aprenderam isso a ler textos retirados da web e de outras fontes. Mas na verdade não fazem a mínima do que é que as palavras querem dizer, o que elas aprenderam foram probabilidades - ou melhor, likelihoods - para palavras (ou tokens) em sequências de texto. No paper que partilhei do GPT estão lá as loss function.

Então a rede é um base de dados per se também? Ou seja se perguntar quem foi o primeiro navegador a chegar ao Brasil, essa informação está contida na própria rede? Ou é algo que está numa base de dados externa que a rede tem acesso de alguma forma, nem que seja um interface com a google?

A rede não é uma base de dados (pelo menos no sentido em que se utiliza base de dados em tecnologias da informação) mas uma rede de neuronios que estão ligados entre si e onde as ligações têm pesos (que foram determinados durante o treino). A rede neuronal é mais uma "calculadora" (os dados com que operam chamam-se tensores na giria, o que a rede faz é operar estes tensores).

Num chatbot como o ChatGPT a informação de quem chegou ao brasil não está em lado nenhum, não está armazenada. Realmente o que a rede aprendeu a fazer é a relacionar as palavras "brasil", "navegador", "chegada", etc.

Agora, para melhorar isso, a rede por ir buscar info à web e que poderá ser utilizado também como input.